大規模言語モデル(LLM)の急速な進化により、エンジニアの働き方は今、大きな転換期を迎えています。単なる「便利なチャットツール」としての利用を超え、LLMを「自律的なデジタル労働力」として業務フローに組み込むことが、フリーランスとしての市場価値を左右する時代となりました。 本記事では、開発の各工程における具体的なユースケースから、高単価案件を獲得するための戦略、そしてプロとして避けては通れないセキュリティリスクまでを網羅的に解説します。

1. フリーランスエンジニアがLLMを業務活用するメリットと市場背景

2026年初頭の現在、生成AI市場は「実験期」を終え、具体的なビジネスインパクトを求める「実利追求期」へと移行しました。フリーランスエンジニアにとって、LLMの活用は単なる作業効率化ではなく、自身の役割を「設計者」や「指揮者」へと拡張させる鍵となります。

1.1 エンジニアの働き方を変える「AIオーケストレーション」時代

これからは、AIという「新たな部下」を使いこなし、複数のエージェントを指揮する「オーケストレーション能力」が求められる傾向があります。 生成AIの進化により、仕様書に基づく実装作業の一部は自動化・効率化が進んでいます。その結果、エンジニアには、より上流工程であるアーキテクチャ設計や、ビジネス課題を踏まえた技術選定・解決策の立案といった領域での付加価値発揮が、これまで以上に期待されるようになっています。。技術の境界線が溶け合う中で、特定の領域に固執せず、AIと協働して価値を最大化させる姿勢が必要になってくるかもしれません。。

1.2 業務効率化によるリードタイム短縮と時給単価の向上

LLMの活用は、実装スピードを飛躍的に高めるだけでなく、プロジェクト全体のリードタイムを劇的に短縮します。ある調査では、AIペアプログラミングツールの利用により、タスク完了速度が約55.8%向上したというデータも報告されています。創出した時間を高付加価値な設計や学習に投資することで、実質的な時給単価を向上させ、より有利な条件で案件を獲得する好循環を生み出すことにつながるかもしれません。

参考文献

1.3 企業が求める「AIを安全に使いこなせる」人材への需要

現在、多くの企業が「AIで何ができるか」ではなく「AIを使ってどう利益を生むか」という実装力を渇望しています。 特に、機密情報を守りながらLLMを安全にビジネスへ統合できるエンジニアの市場価値は、極めて高く評価される傾向にあります。 「AIネイティブ」な開発スタイルを習得していることは、案件獲得における強力な差別化要因となり、最終的な報酬額にも直結する重要な要素の一つです。

2. 【上流工程】要件定義・設計におけるLLM活用ユースケース

システム開発の成否を分ける上流工程において、LLMは思考を整理し、ドキュメントの質を底上げする「壁打ち相手」として非常に優秀です。 人間が数時間かけて行っていた情報の整理や比較検討が、AIとの対話によって数分で完了する場面も増えています。

2.1 議事録からの要件草案・受入条件の自動生成

クライアントとのミーティングで作成した議事録から、要件定義書のドラフトを自動生成することが可能です。 ヒアリング内容をLLMに入力し、「Must/Should/Could」といった優先度付けや、テスト可能な受入条件の整理を指示しましょう。 最新の検証では、わずか15分で要件整理から簡易的なフォーム構築までを完了させた事例もあり、初動のスピードを圧倒的に高められます。

2.2 アーキテクチャ設計の壁打ちと技術選定の比較検討

複数の技術スタックで迷った際、それぞれのメリット・デメリットをLLMに比較させ、プロジェクトの制約に最適な案を模索できます。 「セキュリティを最優先する場合のRustとGoの比較」といった具体的な条件を与えることで、客観的な判断材料を迅速に収集できるのが利点です。 さらに、脅威モデリング(潜在的なセキュリティリスクの特定)の観点出しを依頼すれば、設計の抜け漏れを防ぐ強力なサポーターとなります。

2.3 提案書・見積書の作成補助と「前提条件」の明確化

見積もりの根拠となるWBS(作業分解構造)のドラフト作成も、LLMが得意とする領域の一つです。 過去の類似案件のデータをテンプレートとして参照させれば、工数見積もりの精度を上げつつ、説得力のある提案資料を短時間で作成できます。 特に「見積もりに含まない範囲(スコープ外)」などの前提条件を漏れなく抽出させることで、後のトラブルを未然に防ぐ効果も期待できます。

3. 【実装工程】コーディング支援におけるLLM活用ユースケース

実装フェーズでのLLM活用は、もはや「補助」ではなく「標準」と言っても過言ではありません。GitHub CopilotやCursorといったツールの活用により、タイピング量を減らしつつ、より本質的なロジックの実装に集中できる環境が整っています。

3.1 ボイラープレート(雛形)の生成とリファクタリング案の提示

新規機能の実装時に、繰り返しの多いボイラープレートコードを数秒で生成させることで、開発の立ち上がりを加速できます。 また、既存の「動くが読みにくいコード」を改善するために、デザインパターンに基づいたリファクタリング案を提示させるのも効果的です。 正規表現や複雑なSQLクエリといった、書くのに手間がかかるロジックの生成においても、LLMは非常に高い生産性を発揮します。

3.2 レガシーコードの読解とモダン言語への移行支援

ドキュメントが不足している古いシステムのコードを読み解く際、LLMによる解説機能は救世主となります。 「この古いPHPのロジックを、TypeScriptで書き直して」といった依頼により、言語間の翻訳を高い精度で行うことが可能です。 レガシーシステムのモダン化(マイグレーション)案件は需要が高いため、LLMを武器にこれらの案件を効率よく消化する戦略は非常に有効です。

3.3 GitHub CopilotやCursorなど、IDE統合型AIツールの活用

IDE(統合開発環境)に組み込まれたAIツールを使えば、コメントを書くだけで実装案が提示されるインライン補完が可能になります。 特に「Cursor」のような最新ツールは、プロジェクト全体のファイルをコンテキストとして把握し、ファイル間を跨いだ修正案の提示も得意としています。 心理的負担を軽減しながら開発を進められるため、集中力を維持しやすく、一人で複数人分の開発スピードを実現することも夢ではありません。

4. 【テスト・保守運用】品質担保とドキュメント作成のユースケース

エンジニアが敬遠しがちなテストケースの作成やドキュメント整備こそ、LLMの「整理能力」と「網羅性」が最も活きる領域です。 品質管理をAIに任せることで、リリース後のバグや運用トラブルを最小限に抑えることが可能になります。

4.1 テスト観点の洗い出しとテストコード(単体テスト)の自動生成

仕様書やソースコードを基に、正常系だけでなく境界値やエッジケースを含むテスト観点を網羅的に抽出できます。 抽出された観点に基づき、VitestやJestなどのテストコードを自動生成させることで、テスト工数を大幅に削減可能です。 AIを「第3のテスター」として活用すれば、自分では気づきにくい仕様の矛盾や考慮漏れを早期に発見できるメリットがあります。

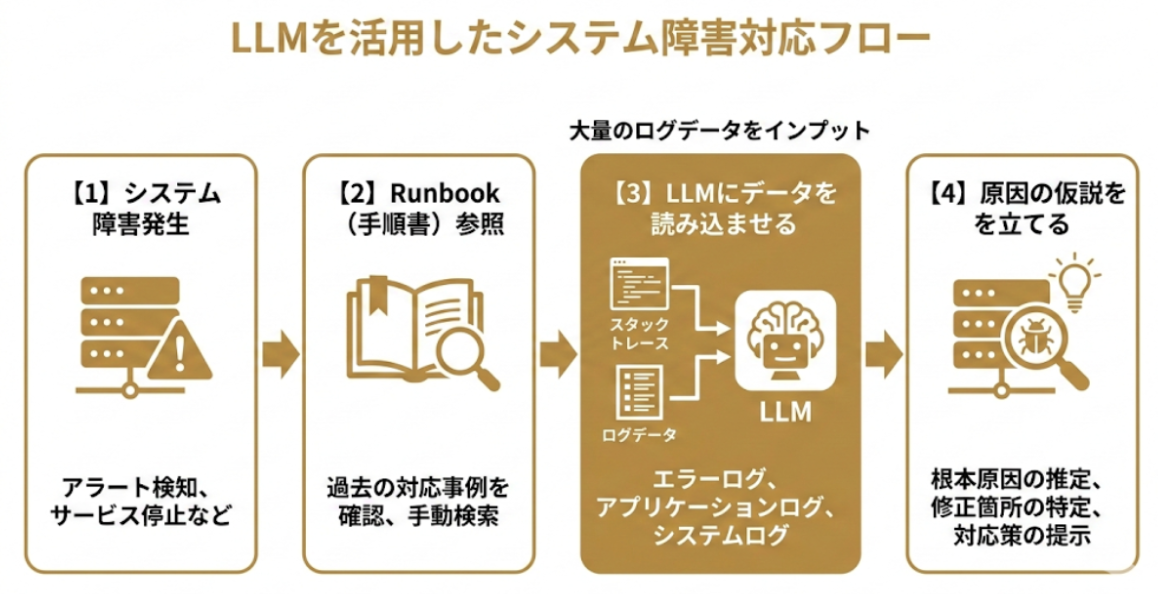

4.2 エラーログの要約と障害発生時の一次切り分け支援

システム障害が発生した際、膨大なスタックトレースやログデータをLLMに読み込ませ、原因の仮説を立てさせることができます。 「直近のデプロイ内容と照らし合わせて、最も可能性の高い原因は?」といった問いかけにより、調査時間を大幅に短縮可能です。 また、過去の障害対応手順(Runbook)を参照させれば、緊急時でも冷静かつ迅速な一次切り分けを支援してくれます。

4.3 README、API仕様書、運用マニュアルの半自動生成

ソースコードのコメントやAPIの実装から、READMEやSwagger形式の仕様書を逆生成することが可能です。 エンジニアが後回しにしがちな運用マニュアルの作成も、LLMなら「構成案」から「詳細な手順」までを一気に書き上げてくれます。 高品質なドキュメントが整備されていることは、クライアントからの信頼に直結し、将来的な保守案件の継続受注にも繋がる重要なポイントです。

5. 業務効率を最大化するLLMモデルとツールの使い分け戦略

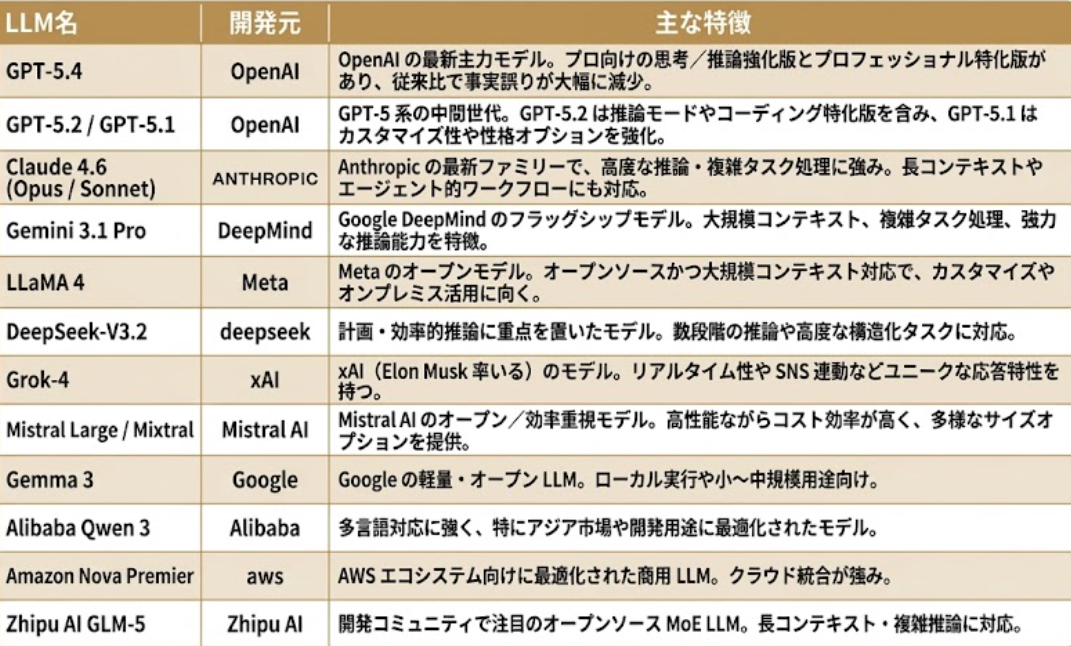

2026年現在の市場には、それぞれ異なる特性を持つ複数のLLMが存在しています。 それらをタスクの難易度や性質に応じて「使い分ける」ことが、プロのフリーランスとしての腕の見せ所です。

5.1 対話型LLMの特性比較(ChatGPT系とClaude系の得意分野)

「GPT-5.2」などの最新GPT系は、論理的推論や数学的な問題解決において極めて高いパフォーマンスを発揮します。 一方、「Claude 4.6」シリーズは、文脈の深い理解や長文ドキュメントの処理において評価が高く、特に数千ページ規模の資料解析に強みを持ちます。 「正確なロジック生成はGPT、仕様書の要約やアーキテクチャの相談はClaude」といった使い分けが、現状のベストプラクティスと言えるでしょう。

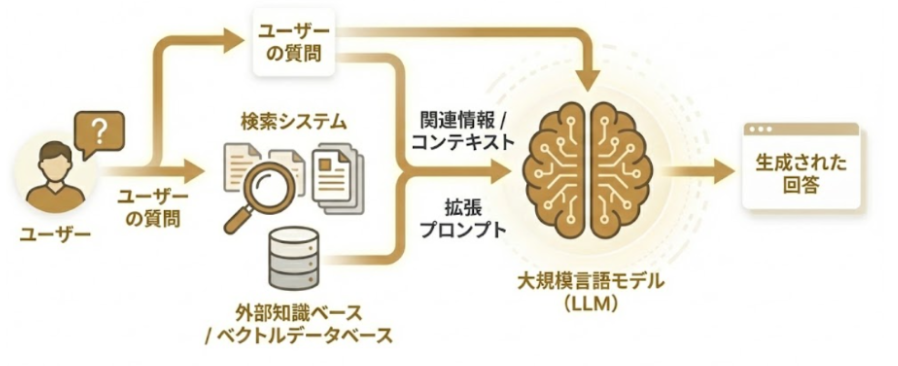

5.2 個人開発環境へのRAG(検索拡張生成)の導入

自分自身の過去のコードベースや、顧客ごとの特定仕様をLLMに参照させる「RAG」の仕組みを導入すると、回答の精度が飛躍的に向上します。 「過去の自分が実装した機能を参考にして、今回の機能を書いて」といった、自分専用のナレッジに基づいた指示が可能になるためです。 案件や顧客ごとにナレッジベースを分割して運用することで、情報の混同を防ぎつつ、プロジェクトに特化した強力なアシスタントを構築できます。

5.3 定型業務を自動化する「プロンプトテンプレート」の運用

よく使う指示やワークフローは、「プロンプトテンプレート」として体系化し、個人の資産として蓄積していきましょう。 例えば「週次報告書の作成」や「コードレビューの観点チェック」などをワンクリックで実行できるように設定します。 さらにSlackやチケット管理ツールとAPI連携させれば、日常的なルーチンワークを半自動化し、より創造的な業務に時間を割けるようになります。

6. フリーランスが直面する情報漏洩リスクとセキュリティ対策

LLMの活用において、最も警戒すべきは「顧客の機密情報」の取り扱いです。 一度外部に流出したデータは取り戻すことができず、損害賠償や社会的信用の失墜を招くため、プロとして厳格なマイルールを設ける必要があります。

6.1 プロンプト経由での機密情報漏洩リスクと「入力データの分類」

安易に顧客のソースコードやAPIキー、個人情報をLLMに入力してはいけません。 入力されたデータがモデルの「再学習」に利用される設定になっている場合、他者の回答として自社の機密情報が露出するリスクがあるためです。 「公開可能な汎用ロジック」と「絶対に外に出せない秘匿情報」を明確に分類し、機密情報を扱う際はダミーデータに置き換えるなどの工夫が必須です。

6.2 法人向け(エンタープライズ)プランの活用と学習データ除外設定

「ChatGPT Team/Enterprise」や「GitHub Copilot Business」などの法人向けプランは、入力データが再学習に利用されないことが保証されています。 個人向けプランを利用する場合でも、設定画面から「学習への利用をオプトアウト」する設定が有効になっているかを必ず確認してください。 究極の対策として、インターネットから遮断された環境で動作する「ローカルLLM」を自身のマシンに構築し、完全オフラインで開発する選択肢もあります。

6.3 顧客への事前開示と、情報保護に関するガバナンスの構築

業務で生成AIを使用する際は、クライアントに対して事前に利用の有無や使用するツール、データ保護方針を開示し、合意を得るのが誠実な対応です。 「法人プランを使用し、再学習をオフにしている」といった具体的なセキュリティ対策を逆提案できれば、クライアントの不安を払拭できます。 秘密保持契約(NDA)の内容と照らし合わせ、AI利用が契約違反にならないよう、必要に応じて契約書の文言調整を相談することも検討しましょう。

7. 生成AIの品質リスク(ハルシネーション)と法的な著作権問題

LLMは、事実に基づかない内容を、あたかも正確であるかのように生成してしまうこと(ハルシネーション)があります。 出力された内容を鵜呑みにせず、最終的な品質責任は常に「人間である自分」が負うという覚悟が必要です。

7.1 ハルシネーションの排除と、人間によるファクトチェックの徹底

LLMが生成した技術的な解説やライブラリの使用方法は、必ず公式ドキュメント(一次情報)で裏取りを行う習慣をつけましょう。 存在しないAPIメソッドや、既に非推奨となった古い情報を提示されるケースも少なくありません。 「AIは嘘をつく可能性がある」という前提に立ち、特に数値や重要なロジックに関しては疑ってかかるレビュー体制が不可欠です。

7.2 生成コードの脆弱性リスクと、テスト・静的解析の必須化

ある研究調査では、AIが生成したコードの約40%に何らかの脆弱性が含まれる可能性があるという結果も報告されています。 SQLインジェクションやクロスサイトスクリプティング(XSS)など、典型的な脆弱性が紛れ込んでいないか、静的解析ツールや人の目によるチェックが必須です。 「AIが書いたから安心」ではなく、むしろ「AIが書いたからこそ、より厳格なセキュリティテストを行う」という姿勢が品質を担保します。

参考文献

7.3 著作権侵害リスクと「出力結果に創作的寄与を加える」原則

生成されたコードが、既存のオープンソースソフトウェアのライセンス(GPLなど)に抵触していないかを確認する注意が必要です。 また、AIの出力をそのまま納品した場合、著作権が発生せず、クライアントの権利を保護できない法的リスクも指摘されています。 AIの出力を叩き台としつつ、人間が「創作的な寄与」を加えて完成させることで、法的な著作物性を確保し、権利関係のトラブルを回避しましょう。

8. LLMスキルを武器にして高単価案件を獲得するキャリア戦略

LLMを使いこなすスキルは、エンジニアにとって提案力や業務効率を高める重要な強みの一つになりつつあります。。 実装業務にとどまらず、企業のAI活用を支援する立場へと役割を広げることで、より高付加価値なポジションを目指すことが可能です。その結果として、報酬水準の向上につながるケースもあります。

8.1 「LLMを使う側」から「AIシステムを作る側」へのシフト

ChatGPTを活用するだけでなく、LlamaIndexやDifyなどのツールも活用しながら、クライアント固有の要件に合わせたAIシステムを設計・構築できる立場を目指すことも一つの選択肢です。RAG構築やAIエージェント開発は、PoCから本番導入フェーズへ移行する企業が増えている領域です。難易度や責任範囲に応じて、単価が相対的に高めに設定される傾向も一部で確認されています。「AIを導入したいが、どうすればいいか分からない」という顧客の課題に対し、具体的な実装案を提示できるエンジニアは、市場で圧倒的に希少な存在です。

8.2 法務・セキュリティ要件を理解した「コンサルティング型」への進化

技術的な実装力に加え、前述の「セキュリティ対策」や「契約実務」の知識をセットで提供できれば、技術顧問やコンサルタントとしての道が開けます。 「安全なAI利用ガイドラインの策定」や「適切なプラン選定の助言」は、大手企業ほど強く求めている専門領域です。 リスク管理と実装の両輪を回せる人材になれば、時給10,000円を超えるような高付加価値案件へのアクセスも現実的になります。

8.3 自身のAI活用ノウハウを可視化するポートフォリオの作成

自分がどのようにLLMを活用し、どの程度の成果(コスト削減やスピードアップ)を出したのかを、具体的な数値で可視化しておきましょう。 「AIを使って開発効率を2倍にした実績」や「RAGを用いた社内検索システムのプロトタイプ」は、クライアントへの強力なアピール材料になります。

9. まとめ:LLMを最強のパートナーとし、フリーランスとして飛躍しよう

LLMはエンジニアの仕事を奪う「敵」ではなく、使い方次第で開発の進め方そのものを変える「パートナー」です。 単なる作業の効率化ツールではなく、発想の補助、試行回数の増加、設計や検証の高速化を通じて、エンジニアの能力とアウトプットのスケールを拡張します。 技術の進化は止まりません。重要なのは「AIに何を任せるか」ではなく、「AIという力をどのような方向へ導くか」という設計力や判断力です。 人間の役割は、AIを使って作業を速くすることだけではなく、その力を社会やビジネスの価値創出へと結びつける指揮を担うことにあります。 まずは日常の小さなドキュメント作成や、テストケースの案出しからLLMの導入を検討してみることを推奨します。 「スモールスタート」でAIとの協働に慣れ、徐々に活用範囲を広げていくことが、将来的なキャリアの安定と飛躍に繋がります。 最新のAI動向をキャッチアップし続け、Track Worksであなたの能力を最大限に発揮できる次の挑戦を見つけましょう。